Od pomysłu do zdefiniowanego problemu: dobry start z AI

Dlaczego „pomysł na aplikację” to za mało

Sam pomysł typu „apka do zarządzania czasem” albo „platforma do nauki języków” nie nadaje się jeszcze do szybkiego prototypowania z użyciem narzędzi AI. Modele językowe świetnie rozwijają niejasne koncepcje w niekończące się listy funkcji, ale bez precyzyjnie opisanego problemu użytkownika generują głównie szum. Dla procesu „od pomysłu do działającego prototypu” punktem wyjścia nie jest kategoria aplikacji, lecz konkretny scenariusz życia użytkownika, w którym cierpi na jasno nazwany problem.

Różnica jest praktyczna: zdanie „apka do zarządzania czasem” nie mówi nic o tym, co powinien robić pierwszy prototyp. Natomiast stwierdzenie „freelancer IT gubi się w dziesiątkach zgłoszeń od klientów i potrzebuje prostego sposobu, by codziennie rano wybrać 3 najważniejsze zadania” natychmiast zawęża zakres. Z takiego opisu da się wyciągnąć konkretne ekrany i flow. Sygnałem ostrzegawczym jest moment, w którym o aplikacji potrafisz mówić tylko w kategoriach „będzie pomagać ludziom lepiej coś robić”, bez żadnego konkretu.

Jeśli już na starcie nie ma jasno nazwanego bólu użytkownika, narzędzia AI staną się generatorem fajerwerków: dziesiątki funkcji, modułów, integracji – bez wyraźnego kryterium, co trafi do pierwszej wersji. Efekt to „prototyp wszystkiego”, którego nie da się skończyć w rozsądnym czasie, a testy z użytkownikami nie przynoszą jasnych wniosków, bo każdy używa go inaczej. Minimum to opis jednej grupy użytkowników, jednego celu i jednego kontekstu użycia.

Trzy kluczowe pytania: kto, co, w jakim kontekście

Dla szybkiego prototypowania z AI wystarczy prosta struktura problemu. Zamiast pracować nad rozbudowanymi personami marketingowymi, lepiej odpowiedzieć na trzy minimalne pytania:

- Kto? – jedno zdanie opisujące typowego użytkownika (rola, poziom wiedzy, istotne ograniczenia).

- Co chce osiągnąć? – zwięzły opis celu z perspektywy użytkownika, nie funkcji systemu.

- W jakim kontekście? – kiedy, gdzie, na jakim urządzeniu i w jakiej sytuacji emocjonalnej używa narzędzia.

Przykład: „Właściciel małej restauracji (kto) chce w prosty sposób codziennie opublikować menu dnia na Facebooku i stronie WWW (co), najczęściej rano w biegu, na telefonie, bez znajomości narzędzi marketingowych (w jakim kontekście).” Takie trzy zdania wystarczą, by poprowadzić AI w stronę użytecznego prototypu zamiast abstrakcyjnych funkcji.

Punkt kontrolny na tym etapie: jeśli opis użytkownika i jego celu zaczyna przypominać prezentację sprzedażową („platforma rewolucjonizująca branżę X”), a nie zwykłe zdania z życia, warto cofnąć się o krok. AI dużo lepiej pracuje na prostych, codziennych opisach niż na marketingowych ogólnikach.

Jak wykorzystać LLM do doprecyzowania problemu i scenariuszy

Modele językowe, takie jak ChatGPT, działają tu jak kompetentny rozmówca, który dopytuje, porządkuje i urealnia scenariusze. Zamiast prosić od razu „wygeneruj specyfikację aplikacji”, lepiej użyć AI jako partnera do doprecyzowania problemu. Pomocny schemat promptu:

„Opiszę krótko użytkownika i problem. Twoje zadanie: 1) doprecyzować problem w formie 3–5 krótkich scenariuszy użycia, 2) wskazać, jakie informacje są nadal niejasne. Użytkownik: […]. Problem: […].”

AI powinno odpowiedzieć m.in. listą konkretnych mikro-sytuacji: „Użytkownik rano przegląda listę zamówień i…”, „Wieczorem chce szybko sprawdzić…”. To idealny materiał do dalszego zawężania MVP. Jeśli odpowiedź jest nadal zbyt ogólna, można zawęzić kontekst, np. „Skup się tylko na sytuacjach, które trwają poniżej 5 minut i da się je wykonać na telefonie”.

Sygnałem ostrzegawczym jest sytuacja, w której mimo kilku iteracji AI nie potrafi wygenerować konkretnych scenariuszy, tylko w kółko powtarza to samo w innych słowach. To znak, że wkład danych wejściowych jest zbyt ubogi lub zbyt abstrakcyjny. W takiej sytuacji lepiej zrobić krok wstecz i porozmawiać z realnymi użytkownikami, zamiast próbować „wymusić” na AI sensowną strukturę.

Sygnały, że pomysł jest jeszcze zbyt mglisty

Przed przejściem do projektowania funkcji i makiet warto wykonać szybki audyt klarowności pomysłu. Lista ostrzegawczych oznak jest krótka, ale skutecznie filtruje pomysły:

- Pomysł da się opisać wyłącznie w jednym ogólnym zdaniu typu „apka do X dla wszystkich”.

- Nie potrafisz wskazać choćby jednego realnego użytkownika z imieniem (np. „Ania z księgowości”), do którego pasuje opis.

- Brakuje „momentu użycia”: nie wiesz, kiedy konkretnie, w trakcie jakiego dnia, w jakiej sytuacji ktoś uruchamia aplikację.

- Zadając AI pytanie o scenariusze użycia, dostajesz dziesiątki przypadków, które nie wchodzą w konflikt z rzeczywistością, ale żaden nie wydaje się szczególnie „prawdziwy”.

Jeżeli którykolwiek z tych sygnałów się pojawia, lepiej na chwilę zatrzymać się z dalszym prototypowaniem. Kolejne kroki – wybór narzędzi AI, makiety, MVP – będą jedynie przyspieszać błąd, zamiast przyspieszać dojście do wartości.

User story jako minimum formalizacji problemu

Prostą i wystarczającą formą opisu problemu na potrzeby prototypowania jest jedno, konkretne user story. W wersji minimalnej może mieć postać:

„Jako [typ użytkownika] chcę [konkretna czynność], aby [konkretny efekt/korzyść].”

Na przykład: „Jako właściciel małej restauracji chcę jednym kliknięciem wygenerować i opublikować menu dnia na Facebooku, aby nie tracić rano 20 minut na ręczne pisanie postów.” To zdanie natychmiast sugeruje wymagania dla prototypu: integracja z Facebookiem może być atrapą, ale generowanie treści menu i prosty podgląd posta muszą działać.

Punkt kontrolny: spisz jedno takie user story w zwykłym dokumencie i pokaż osobie spoza projektu. Jeśli rozumie, o co chodzi, bez dodatkowych wyjaśnień, pomysł jest wystarczająco uziemiony, żeby przejść do definiowania minimum funkcji. Jeśli nie – pracuj nad user story, zamiast iść dalej.

Jeśli nie umiesz jednym akapitem opisać użytkownika, jego celu i kontekstu, to jeszcze nie ma czego prototypować. Jeśli AI po kilku iteracjach nadal produkuje dziesiątki funkcji, a ty nie umiesz wybrać 2–3 najważniejszych, to sygnał, że problem jest za szeroki i wymaga dalszego doprecyzowania, zanim zaangażujesz narzędzia AI w generowanie kodu i UI.

Minimalny zakres funkcji (MVP) pod prototyp – jak nie przesadzić

MVP jako wersja do nauki, nie „prawie gotowy produkt”

W kontekście szybkiego prototypowania z AI MVP (Minimum Viable Product) nie oznacza „okrojonej wersji gotowej aplikacji”, tylko wersję do nauki. Jej celem nie jest obsłużenie wszystkich scenariuszy użytkowników, ale umożliwienie sprawdzenia, czy rozwiązanie w ogóle trafia w sedno problemu. Działa to szczególnie mocno przy wykorzystaniu generatorów kodu i narzędzi low-code – bardzo łatwo jest „przy okazji” dobudować jeszcze kilka ekranów i integracji.

MVP na tym etapie ma odpowiedzieć na jedno pytanie: „Czy użytkownicy widzą w tym narzędziu realną wartość w kluczowym scenariuszu?”. Wszystko, co nie służy odpowiedzi na to pytanie w pierwszych testach, jest kandydatem do wycięcia. To dotyczy nawet funkcji, które „na pewno będą potrzebne” w dalszej fazie rozwoju.

Punkt kontrolny: w dokumencie opisującym MVP powinno dać się wyróżnić jedno główne zadanie użytkownika, które da się zrealizować end-to-end w ramach prototypu. Jeśli nie umiesz go wskazać, tylko wymieniasz listę niezależnych funkcji, trudniej będzie ocenić, czy prototyp spełnia swoją rolę.

Jak użyć AI do mapowania i priorytetyzacji funkcji

Modele językowe świetnie nadają się do pierwszego rozwinięcia listy funkcji na podstawie user story, ale równie dobrze sprawdzają się w roli „noża”, którym przycinasz listę do sensownego minimum. Praktyczny sposób pracy wygląda następująco:

- Na podstawie jednego lub dwóch user stories poproś AI: „Wypisz listę funkcji w formie krótkich punktów, nie więcej niż 20, potrzebnych do obsłużenia tego scenariusza.”

- Następnie: „Podziel te funkcje na trzy grupy: MUST (konieczne, by scenariusz zadziałał), SHOULD (ważne, ale niekonieczne w prototypie), COULD (miłe dodatki). Wyjaśnij w jednym zdaniu przy każdym przypisaniu.”

- Na końcu: „Zredukuj grupę MUST do absolutnego minimum, tak by użytkownik mógł przejść od punktu A do Z bez ręcznej ingerencji twórcy aplikacji.”

Ten prosty proces zmusza AI do explicite uzasadnianej priorytetyzacji zamiast tworzenia list „wszystko jest ważne”. Potem to ty jako projektant wykonujesz ostateczne cięcie – ważne, by rzeczywiście odrzucić część funkcji z grupy SHOULD i COULD, a nie „tymczasowo zostawić, bo AI podpowiedziało”.

Sygnał ostrzegawczy: jeśli po dwóch–trzech iteracjach nadal masz listę kilkunastu funkcji w kategorii MUST, problem jest albo zbyt szeroki, albo za mało konkretnie opisany. W takim wypadku lepiej zdefiniować węższy scenariusz niż próbować zmieścić w prototypie wszystko.

Co musi działać naprawdę, a co może być atrapą (mock)

W szybkim prototypowaniu z AI jednym z kluczowych wyborów jest rozróżnienie pomiędzy tym, co musi działać technicznie, a tym, co może być tylko symulowane. To decyduje o tym, czy prototyp powstanie w kilka dni, czy w kilka tygodni. Dobre kryteria są trzy:

- Bez czego użytkownik nie doświadczy kluczowej wartości? – tu funkcja musi być realna, nawet jeśli technicznie toporna.

- Co można zasymulować ręcznie „po drugiej stronie”? – np. ręczne zatwierdzanie, udawane integracje, statyczne dane.

- Co można odwzorować prostym statycznym ekranem albo mockiem API? – np. lista produktów z pliku JSON zamiast prawdziwej bazy.

Przykład: w aplikacji, która ma sugerować właścicielowi restauracji treść posta z menu dnia, generowanie tekstu posta jest krytyczne – tu warto użyć realnego modelu językowego. Natomiast publikacja posta na Facebooku może być atrapą: przycisk „Opublikuj” zapisujący treść do loga czy wysyłający maila do testera. Użytkownik i tak przede wszystkim ocenia jakość propozycji treści.

Punkt kontrolny: sporządź krótką listę ekranów i przy każdej kluczowej akcji oznacz ją jako „REAL” (rzeczywiste działanie) albo „MOCK” (symulacja). Jeżeli więcej niż 50–60% akcji wymaga od razu pełnej implementacji, ryzyko przekroczenia czasu prototypowania rośnie bardzo szybko.

Jeden główny scenariusz od A do Z

Prototyp z użyciem narzędzi AI najłatwiej zbudować wokół jednego, spójnego głównego przepływu użytkownika. Zamiast rozpraszać się na wiele różnych ścieżek, opłaca się zdefiniować jeden proces: od wejścia do aplikacji do uzyskania kluczowego efektu. Może to być na przykład:

- „Dodanie jednego zadania, jego automatyczna kategoryzacja przez AI i wyświetlenie priorytetu na liście”.

- „Wygenerowanie menu dnia na podstawie listy składników i podgląd propozycji posta na Facebooku”.

- „Zapisanie się na listę mailingową z propozycją personalizowanego powitania wygenerowanego przez AI”.

Ten przepływ trzeba rozpisać w 5–10 krokach, używając normalnego języka, a potem poprosić AI: „Na podstawie tych kroków opisz minimalny zestaw ekranów i akcji użytkownika, który pozwoli przejść tę ścieżkę od początku do końca.” To wstęp do projektowania makiet i doboru narzędzi AI.

Punkt kontrolny: na jednej kartce (lub w jednym ekranie dokumentu) powinna zmieścić się cała ścieżka „od A do Z” w formie listy kroków. Jeżeli opis rozlewa się na kilka stron i zawiera liczne odgałęzienia („jeśli… to…”, „w przypadku gdy…”), to znak, że zakres MVP jest przeskalowany jak na pierwszy prototyp.

Jeśli pierwszy prototyp wymaga jednocześnie pełnego logowania, zarządzania kontem, płatności online i panelu administracyjnego, zakres jest wyraźnie zawyżony. Jeśli nie potrafisz w jednym zdaniu opisać, co użytkownik zrobi od początku do końca w ramach tej wczesnej wersji, to znaczy, że nie masz jeszcze gotowego MVP – jedynie katalog pomysłów na produkt.

Wybór narzędzi AI i środowiska: minimum technologii, maksimum efektu

Główne klasy narzędzi wspierających prototypowanie

Stos technologiczny dla szybkiego prototypowania z AI można opisać w kilku głównych kategoriach. Dobrze zrozumieć ich rolę, zanim zaczniesz spontanicznie dokładać kolejne usługi do projektu.

Narzędzia „no-code” i „low-code” jako szkielet aplikacji

Dla większości prototypów najszybszą drogą jest użycie platform no-code/low-code jako szkieletu aplikacji, a modele AI jedynie jako „silnika” funkcji inteligentnych. W praktyce oznacza to wybór jednego środowiska, które zapewni:

- proste tworzenie ekranów (formularze, listy, szczegóły rekordów),

- podstawowe zarządzanie danymi (tabele, relacje, uprawnienia),

- łatwe wywoływanie zewnętrznych API (w tym API modeli AI),

- hosting i prostą obsługę użytkowników (logowanie, konta testowe).

Przy wyborze platformy no-code/low-code kryteria są bardziej krytyczne niż nazwa narzędzia. Lista rzeczy do sprawdzenia przed decyzją:

- Czas do pierwszego klikalnego ekranu – czy w 1–2 godziny zbudujesz prosty formularz i listę danych?

- Obsługa API – czy da się w kilku krokach skonfigurować zapytanie do modelu AI i zmapować odpowiedź na pola w aplikacji?

- Ograniczenia planu – czy darmowy lub najtańszy plan nie blokuje kluczowych funkcji (API, liczba rekordów, liczba użytkowników testowych)?

- Eksport lub migracja – czy w razie potrzeby przeniesiesz dane i logikę do „prawdziwego” stacku bez przepisywania wszystkiego od zera?

Punkt kontrolny: jeśli po jednym popołudniu pracy nadal walczysz z podstawową konfiguracją danych albo integracją z modelem AI, zmień platformę zamiast walczyć z tą pierwszą. Prototyp ma przyspieszać wnioski, nie budować przywiązania do technologii.

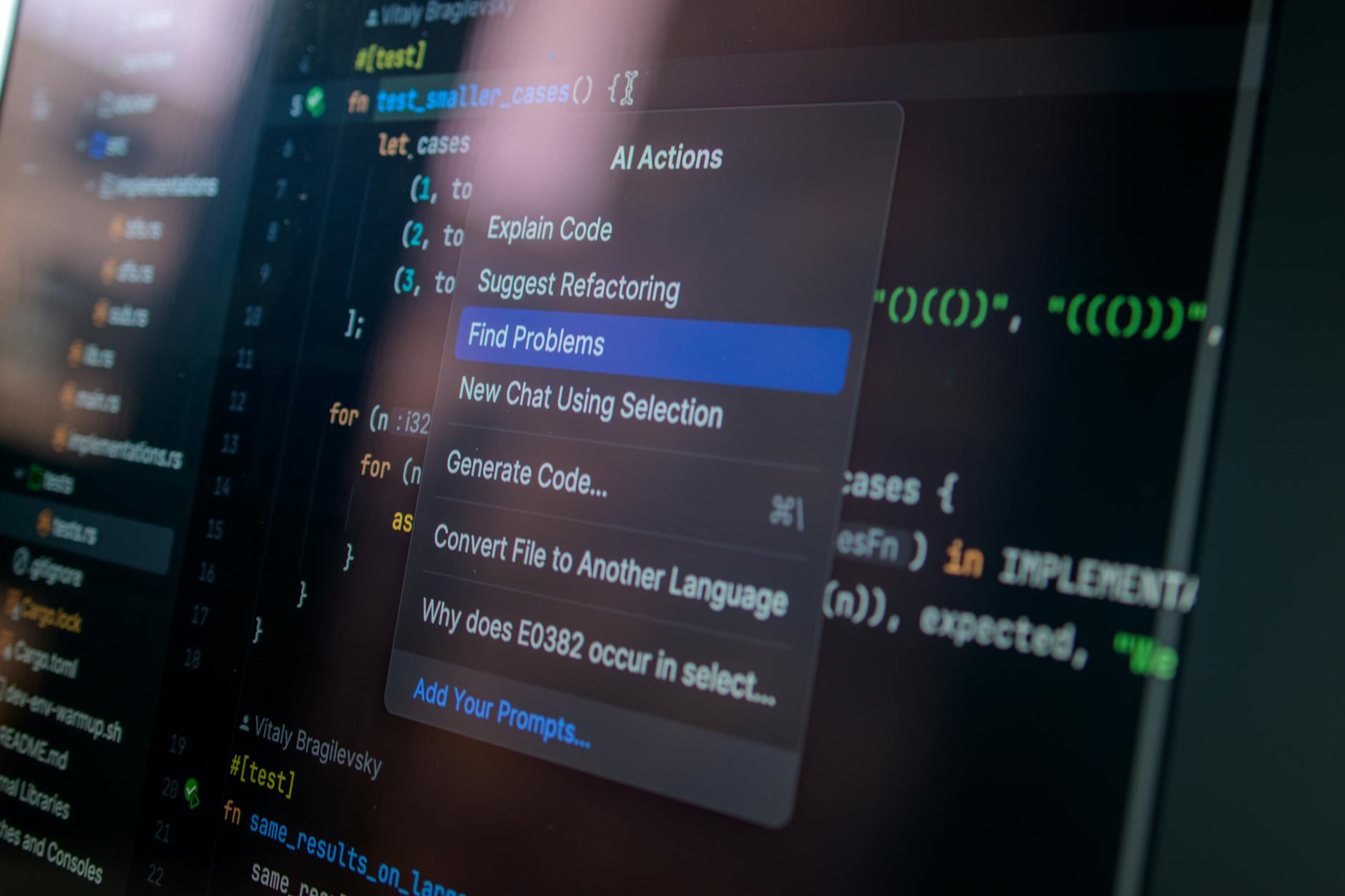

Modele językowe jako „silnik logiki” i generowania treści

Modele językowe w prototypach pełnią zwykle jedną z trzech ról: generują treści (teksty, podsumowania), przetwarzają dane wejściowe użytkownika (np. klasyfikacja, ekstrakcja pól) lub symulują „inteligentnych” asystentów (czat, rekomendacje). Zamiast rozpraszać się na wiele modeli, minimum to:

- jeden model ogólnego przeznaczenia – do generowania tekstów i prostych transformacji,

- jeden sposób wołania modelu – przez API z poziomu twojej platformy lub back-endu pomocniczego.

Przy wyborze konkretnego modelu i dostawcy kluczowe są:

- Stabilność i przewidywalność – czy odpowiedzi są wystarczająco spójne, by prototyp działał bez ręcznego poprawiania wyników co chwilę?

- Łatwość integracji – czy są gotowe konektory lub dobrze opisane API z przykładami w wybranej przez ciebie technologii?

- Koszt testów – czy możesz zrealizować kilkaset–kilka tysięcy zapytań bez przekroczenia sensownego budżetu na fazę eksperymentu?

Sygnał ostrzegawczy: jeśli prototyp zaczyna wymagać konfigurowania wielu modeli o różnych parametrach temperatury, kontekstach i specjalizacjach, a użytkownik końcowy nie odczuje tej różnorodności w pierwszym teście, to zakres technicznej zabawy jest przesadzony względem celu MVP.

Narzędzia automatyzacji przepływów (integrowanie bez pisania back-endu)

Część zadań prototypu nie dotyczy wcale UI ani generowania treści, tylko „klejenia” usług: wysłanie maila, zapis do arkusza, wywołanie webhooka. Zamiast od razu pisać back-end, szybciej i bezpieczniej jest użyć narzędzi do automatyzacji przepływów (typu integratory online).

Kluczowe zastosowania takich narzędzi w prototypowaniu z AI to m.in.:

- reakcja na akcję użytkownika (np. zapis formularza) i wywołanie modelu AI w tle,

- transformacja odpowiedzi z modelu (np. podział na pola, zapis do kilku różnych systemów),

- symulacja integracji z zewnętrznymi usługami (social media, CRM, systemy płatności).

Punkt kontrolny: jeśli dla prostego przepływu (formularz → AI → zapis wyniku) potrzebujesz więcej niż 3–4 kroki w narzędziu automatyzacji, uprość proces biznesowy. Prototyp ma demonstrować wartość, nie pokaz możliwości integratora.

Prosty back-end jako „zawór bezpieczeństwa”

Czasem platforma no-code i integrator nie wystarczą – pojawia się potrzeba wykonania niestandardowych obliczeń, weryfikacji danych lub bezpieczniejszego przechowywania kluczy API. Zamiast pełnowymiarowego serwera aplikacji, w fazie prototypu wystarczy minimalny back-end:

- funkcje serverless (np. pojedyncze endpointy w chmurze),

- lekki framework REST z 2–3 ścieżkami,

- magazyn danych typu dokumentowego na potrzeby logów i historii zapytań do AI.

Kryteria, kiedy warto wprowadzić taki komponent:

- Bezpieczeństwo kluczy i sekretów – jeśli w przeciwnym razie musiałbyś trzymać klucz do API AI bezpośrednio w kliencie (przeglądarka, aplikacja mobilna).

- Walidacja danych – gdy trzeba twardo wymusić format i zakres danych przed przekazaniem do modelu AI.

- Logowanie i audyt – jeżeli pierwsze testy mają dostarczyć twardych danych, jak ludzie faktycznie używają prototypu.

Sygnał ostrzegawczy: jeśli „minimalny back-end” w ciągu kilku dni rozrasta się do osobnego projektu z kilkunastoma endpointami, to znak, że zakres prototypu uciekł spod kontroli. Lepiej przyciąć funkcje niż budować produkcyjną architekturę w fazie walidacji pomysłu.

Minimum narzędzi: jak rozpoznać przerost stacku

Im więcej narzędzi, tym więcej punktów potencjalnej awarii i czasu na ich spajanie. Minimalny stos technologiczny do przeciętnego prototypu z AI można zwykle zamknąć w trzech elementach:

- jedna platforma do UI i danych (no-code/low-code lub prosty front-end + baza),

- jeden dostawca modelu AI,

- jeden sposób integracji (bezpośrednie API, integrator albo własny mini back-end).

Punkt kontrolny: jeśli na diagramie rozwiązania pojawia się więcej niż pięć różnych usług z osobnymi panelami logowania (hosting, baza, AI, integrator, analityka, dodatkowe mikroserwisy), zatrzymaj się i zapytaj: „Które z nich są absolutnie konieczne, by przetestować główny scenariusz użytkownika?”. Cokolwiek nie przejdzie tego testu, odkładasz na później.

Makieta i UX z pomocą AI: od szkicu do klikalnego flow

Dlaczego nie zaczynać od „ładnego UI”

Przy użyciu projektowych narzędzi wspieranych przez AI bardzo łatwo jest stworzyć wizualnie atrakcyjne ekrany już na początku. To jednak pułapka: dopracowana estetyka maskuje braki w przepływie użytkownika. Zamiast skupiać się na kolorach i ikonach, pierwszym celem jest funkcjonalna makieta, która pozwoli przejść główny scenariusz od A do Z bez zastanawiania się „gdzie to kliknąć”.

Kryteria gotowości makiety na tym etapie:

- każdy krok scenariusza ma przypisany ekran lub jego stan,

- użytkownik zawsze widzi, co może zrobić dalej (brak „ślepych zaułków”),

- najważniejsza akcja na każdym ekranie jest łatwa do zidentyfikowania w 1–2 sekundy.

Jeśli po przejściu makiety tester musi pytać „co teraz?” albo „gdzie kliknąć, żeby…”, oznacza to brak dojrzałości UX, niezależnie od tego, jak nowocześnie wygląda interfejs.

Jak użyć AI do przygotowania pierwszej makiety tekstowej

Zanim pojawi się jakiekolwiek narzędzie graficzne, najprostsza wersja makiety może powstać w formie tekstowej – listy ekranów i głównych elementów każdego z nich. Modele językowe świetnie się do tego nadają. Praktyczny sposób pracy:

- Wklej krok po kroku opis głównego scenariusza użytkownika (5–10 kroków).

- Poproś AI: „Na podstawie tego scenariusza zaproponuj listę ekranów aplikacji oraz dla każdego ekranu wypisz: główny cel, kluczowe elementy (przyciski, pola) i możliwe akcje użytkownika. Zrób to w formie listy punktów.”

- Następnie doprecyzuj: „Ogranicz liczbę ekranów do absolutnego minimum, tak aby dało się zrealizować scenariusz end-to-end.”

Punkt kontrolny: jeśli w rezultacie powstaje więcej niż 7–8 unikalnych ekranów, wróć do user story i scenariusza. Na tym etapie większość prototypów powinna zmieścić się w kilku kluczowych widokach; resztę można ukryć za skrótami lub uprościć do dialogów modalnych.

Od tekstu do prostych wireframes z pomocą AI

Kiedy lista ekranów i elementów jest zaakceptowana, kolejnym krokiem są proste, „szkieletowe” makiety (wireframes). Tu również AI może przyspieszyć pracę, ale w roli asystenta, nie automatycznego projektanta. Przykładowe podejście:

- użycie narzędzi UI z funkcją „generate layout from prompt” – wklejasz opis ekranu,

- przekazanie AI informacji o hierarchii elementów: co ma być na górze, co na dole, co na bocznym pasku,

- wykorzystanie modeli generujących pseudokod UI (np. w HTML/JSX), który następnie wklejasz do swojego środowiska.

Przy ocenie wygenerowanych makiet kryteria są bardziej jakościowe niż estetyczne:

- czy główna akcja ma wizualny priorytet (przycisk, miejsce w strukturze),

- czy liczba elementów na ekranie nie przeciąża użytkownika (minimum pól na start),

- czy przejścia między ekranami są jasne bez dodatkowych opisów.

Sygnał ostrzegawczy: jeśli pierwsze makiety generowane przez AI zawierają wiele kart, sekcji, filtrów i dodatkowych opcji, których nie ma w twoim opisie scenariusza, to trzeba przyciąć prompt, a nie akceptować „bogatszą” wersję. Każdy zbędny element to potencjalna komplikacja przy testach z użytkownikami.

Test klikalnego flow zanim powstanie kod

Zanim zaczniesz podłączać modele AI i backend, warto zbudować klikalny prototyp z samych makiet (np. w narzędziu do projektowania UI/UX). Chodzi wyłącznie o sprawdzenie przepływu, nie działania logiki. W takiej wersji wszystkie efekty „inteligentne” można zastąpić statycznymi ekranami „po fakcie”.

Elementy do weryfikacji na tym etapie:

- czy użytkownik rozumie, gdzie zaczyna i gdzie kończy się proces,

- czy nie musi się cofać, aby naprawić drobne błędy (np. edycja danych dostępna w ostatnim kroku),

- czy w miejscach, gdzie AI ma „zrobić coś za użytkownika”, jest jasne, co się wydarzy i co użytkownik zobaczy jako wynik.

Punkt kontrolny: wykonaj 3–5 przejść przez klikalny prototyp z różnymi osobami i każ im głośno komentować, co robią. Jeśli choć jedna osoba nie potrafi ukończyć scenariusza samodzielnie bez podpowiedzi, nie inwestuj jeszcze czasu w implementację logiki AI – najpierw popraw przepływ.

Jak opisywać zachowania UI dla modeli AI generujących kod

Kiedy przepływ jest stabilny, można przejść do generowania kodu UI z pomocą AI. Tu jakość promptów pełni rolę specyfikacji. Zamiast prosić ogólnie „wygeneruj ekran do dodawania zadania”, lepiej użyć precyzyjnego opisu zachowań:

- co dzieje się po kliknięciu każdego przycisku,

- które pola są obowiązkowe, a które opcjonalne,

- jakie komunikaty pojawiają się w przypadku błędu lub powodzenia akcji.

Przykładowy wzór promptu:

„Stwórz komponent ekranu dodawania zadania:

- Pola: tytuł (wymagane), opis (opcjonalne), data (wymagana).

- Po kliknięciu ‘Zapisz’:

- Waliduj wymagane pola.

- Jeśli brakuje danych, pokaż komunikat pod odpowiednim polem.

- Jeśli dane są poprawne, wywołaj funkcję onSave(task), a następnie:

- wyczyść formularz,

- pokaż krótkie powiadomienie ‘Zadanie zapisane’.

- Dodaj przycisk ‘Anuluj’, który resetuje formularz i wywołuje onCancel().”

Sygnał ostrzegawczy: jeśli przekazujesz AI jedynie ogólne opisy („prosty formularz, kilka pól, przycisk zapisz”), a potem poświęcasz godziny na poprawki, to znak, że brakuje specyfikacji zachowań. Modele są dobre w generowaniu struktury, ale wymagają jasnych reguł interakcji.

Współpraca z AI przy iteracjach UX: małe zmiany, częste testy

Po zbudowaniu pierwszej działającej makiety z podpiętym AI największą wartość przynoszą krótkie cykle: test – obserwacja – drobna korekta. Modele AI są szczególnie użyteczne przy drobnych usprawnieniach, np.:

- przepisanie etykiet i komunikatów na bardziej zrozumiałe językowo,

- propozycje skrócenia formularzy lub połączenia kroków,

- generowanie alternatywnych wariantów ekranów pod A/B testy.

Najczęściej zadawane pytania (FAQ)

Jak sprecyzować pomysł na aplikację, żeby AI realnie pomogła w prototypowaniu?

Minimum to zejście z poziomu „apka do X” do poziomu konkretnego bólu użytkownika. Zamiast „platforma do nauki języków”, zapisz jedno zdanie: kto ma problem, z czym dokładnie się mierzy i w jakim momencie dnia najbardziej go to boli. Im bardziej przypomina to zwykłe zdanie z życia („freelancer gubi się w zgłoszeniach, gdy zaczyna dzień pracy”), tym lepiej.

Punkt kontrolny: jeśli po przeczytaniu tego jednego zdania od razu potrafisz narysować 1–2 ekrany lub wyobrazić sobie pierwszy krok użytkownika, opis jest wystarczająco konkretny. Jeśli nadal mówisz tylko „będzie pomagać lepiej zarządzać czasem/finansami/nauką”, to sygnał ostrzegawczy, że pomysł jest zbyt mglisty na sensowne użycie AI.

Jak użyć ChatGPT lub innego LLM do doprecyzowania problemu użytkownika?

Traktuj LLM jak dociekliwego rozmówcę, nie generator gotowej specyfikacji. Dobrze działa schemat: najpierw krótko opisujesz użytkownika i problem, a potem prosisz AI o 3–5 krótkich scenariuszy użycia oraz listę brakujących informacji. Dzięki temu dostajesz mikro-sytuacje („rano przed pracą…”, „wieczorem po zamknięciu lokalu…”), które można dalej zawężać.

Punkt kontrolny: jeśli po 1–2 iteracjach masz kilka konkretnych scenek z życia użytkownika, nadających się na szkice ekranów, AI zostało użyte właściwie. Jeśli mimo doprecyzowań model powtarza w kółko ogólne hasła, problem wejściowy jest zbyt abstrakcyjny – to sygnał ostrzegawczy, żeby wyjść do realnych użytkowników po dane, zamiast męczyć prompt.

Po czym poznać, że pomysł na aplikację jest zbyt ogólny, żeby zaczynać prototyp?

Najczęstsze czerwone flagi to: opis pomysłu mieści się tylko w jednym ogólnym zdaniu typu „apka do X dla wszystkich”, brak choć jednego realnego przykładowego użytkownika z imieniem, brak „momentu użycia” (nie wiesz, kiedy ktoś faktycznie miałby to włączyć) oraz sytuacja, w której AI generuje dziesiątki poprawnych, ale oderwanych od życia scenariuszy.

Jeśli widzisz u siebie którykolwiek z tych sygnałów ostrzegawczych, zatrzymaj się przed wyborem narzędzi czy rysowaniem makiet. W takim stanie każde kolejne narzędzie AI tylko przyspieszy produkcję szumu. Minimum to: 1 grupa użytkowników, 1 jasny cel, 1 konkretny kontekst użycia opisany zwykłym językiem.

Czym różni się dobrze opisany user story od ogólnego „pomysłu na apkę”?

User story ma prostą strukturę: „Jako [typ użytkownika] chcę [konkretna czynność], aby [konkretny efekt]”. W odróżnieniu od hasła typu „apka do zarządzania zadaniami”, user story wymusza wskazanie jednej czynności i jednego efektu, np. „Jako właściciel restauracji chcę jednym kliknięciem opublikować menu dnia, aby nie tracić rano 20 minut na pisanie postów”. To od razu sugeruje, co musi się znaleźć w pierwszym prototypie, a co może być atrapą lub zostać na później.

Punkt kontrolny: pokaż spisane user story osobie spoza projektu. Jeśli rozumie bez dodatkowych pytań, co aplikacja ma robić w pierwszej wersji, poziom formalizacji jest wystarczający. Jeśli potrzebuje długich wyjaśnień „co miałeś na myśli”, user story jest zbyt ogólne – dopracuj je, zanim poprosisz AI o generowanie funkcji czy UI.

Jak zdefiniować MVP aplikacji tworzonej z użyciem narzędzi AI?

W tym kontekście MVP to nie „prawie gotowy produkt z mniejszą liczbą funkcji”, ale wersja do nauki – minimalny zestaw elementów pozwalających sprawdzić, czy rozwiązanie trafia w sedno problemu w jednym kluczowym scenariuszu. Pierwszy prototyp nie musi obsługiwać wszystkich przypadków ani wyglądać „produkcyjnie”; musi za to umożliwiać przejście użytkownika przez jedno pełne zadanie od początku do końca.

Punkt kontrolny: w opisie MVP potrafisz wskazać jedno główne zadanie użytkownika, które da się zrealizować end-to-end w ramach prototypu. Jeśli zamiast tego masz listę luźnych funkcji („logowanie, dashboard, raporty, integracje…”) bez wyraźnego zadania przewodniego, to sygnał ostrzegawczy, że zakres MVP jest źle zdefiniowany i będzie trudny do oceny z użytkownikami.

Jakie pytania zadać sobie przed użyciem AI do generowania listy funkcji?

Zanim poprosisz AI o „funkcje aplikacji”, sprawdź kilka podstawowych kryteriów: czy masz opisane „kto, co, w jakim kontekście”, czy istnieje jedno konkretne user story, czy umiesz nazwać kluczowy moment użycia (np. „15 minut przed otwarciem sklepu”) oraz czy wiesz, które problemy nie mają być rozwiązane w pierwszej wersji. Dopiero wtedy warto prosić model o mapę funkcji z priorytetyzacją.

Jeśli po takim przygotowaniu AI nadal produkuje długą, równorzędną listę modułów bez wyraźnego priorytetu, zawęź prompt: poproś wyłącznie o funkcje niezbędne do realizacji jednego user story. Jeśli to nie pomaga, to sygnał, że twoje wejściowe kryteria są zbyt luźne – minimum to doprecyzowanie celu testów, np. „sprawdzenie, czy użytkownik jest w stanie w 5 minut wykonać X na telefonie”.

Kiedy lepiej iść rozmawiać z użytkownikami zamiast dalej dopracowywać pomysł z AI?

Moment krytyczny jest wtedy, gdy mimo kilku iteracji promptów AI nie jest w stanie wygenerować konkretnych, spójnych scenariuszy użycia, tylko krąży wokół ogólników. Innym sygnałem ostrzegawczym jest sytuacja, w której z każdej sesji wychodzisz z nowym zestawem potencjalnych funkcji, ale nadal nie potrafisz wskazać 2–3 najważniejszych.

Jeśli tak się dzieje, oznacza to zwykle, że brakuje ci realnych danych o zachowaniach i ograniczeniach użytkowników. Wtedy kolejna godzina z AI nie poprawi jakości pomysłu – lepszym krokiem jest krótki wywiad z 2–3 osobami z docelowej grupy. Po powrocie z takiej rozmowy opisy „kto, co, w jakim kontekście” oraz user story stają się dużo ostrzejsze, a narzędzia AI zaczynają dawać znacznie bardziej użyteczne propozycje.

Najważniejsze wnioski

- Sam „pomysł na aplikację” to za mało – punktem wyjścia musi być jasno nazwany ból użytkownika w konkretnym scenariuszu dnia, inaczej AI generuje wyłącznie szum i listy przypadkowych funkcji.

- Minimum opisu problemu to odpowiedź na trzy pytania: kto (typowy użytkownik), co chce osiągnąć (cel z jego perspektywy), w jakim kontekście (moment dnia, urządzenie, sytuacja emocjonalna); jeśli nie da się ich sensownie wypełnić, pomysł jest jeszcze zbyt mglisty.

- LLM warto używać najpierw do doprecyzowania problemu i scenariuszy (3–5 mikro-sytuacji użycia) oraz wykrywania luk informacyjnych, zamiast od razu wymuszać pełną specyfikację aplikacji.

- Sygnałem ostrzegawczym jest sytuacja, gdy mimo kilku iteracji AI nie potrafi wygenerować konkretnych, „życiowych” scenariuszy – wtedy trzeba wrócić do rozmów z realnymi użytkownikami, zamiast dalej tuningować prompt.

- Krótki audyt klarowności pomysłu przed prototypowaniem jest obowiązkowym punktem kontrolnym: jeśli opis sprowadza się do „apka do X dla wszystkich”, brak realnej osoby z imieniem i momentu użycia, a generowane przez AI przypadki są poprawne, lecz „bez krwi i kości” – lepiej wstrzymać budowę MVP.

- Minimum formalizacji problemu to jedno konkretne user story („Jako [typ użytkownika] chcę [czynność], aby [efekt]”), które od razu wskazuje, co musi realnie działać w pierwszym prototypie, a co może być atrapą.